Il y a une certaine tranquillité dans l'idée d'un génome, comme s'il existait entièrement formé, attendant seulement d'être lu. Pourtant, dans la pratique, il arrive en fragments—séquences éparpillées, signaux partiels, morceaux qui doivent être rassemblés et agencés avant que le sens puisse commencer à émerger. Le processus ressemble moins à la lecture d'un livre et plus à l'assemblage d'un texte dont les pages ont été dispersées par le temps et le mouvement.

Dans les laboratoires et les centres de données, ce travail se déroule en silence. Les machines de séquençage produisent d'immenses flux d'informations, chaque ensemble de données portant des traces d'identité biologique. Mais entre les données brutes et l'insight exploitable se trouve un espace d'interprétation, où l'analyse doit être soigneuse, cohérente et précise. C'est dans cet espace que des systèmes comme Metapipeline-DNA commencent à prendre forme.

Conçu pour automatiser et standardiser l'analyse du séquençage génomique, Metapipeline-DNA s'attaque à un défi qui a grandi avec le domaine lui-même. À mesure que les technologies de séquençage ont progressé, le volume de données a rapidement augmenté, entraînant une variabilité dans la manière dont ces données sont traitées. Différents outils, flux de travail et paramètres peuvent conduire à des différences dans les résultats, même lorsqu'ils sont appliqués à la même séquence sous-jacente.

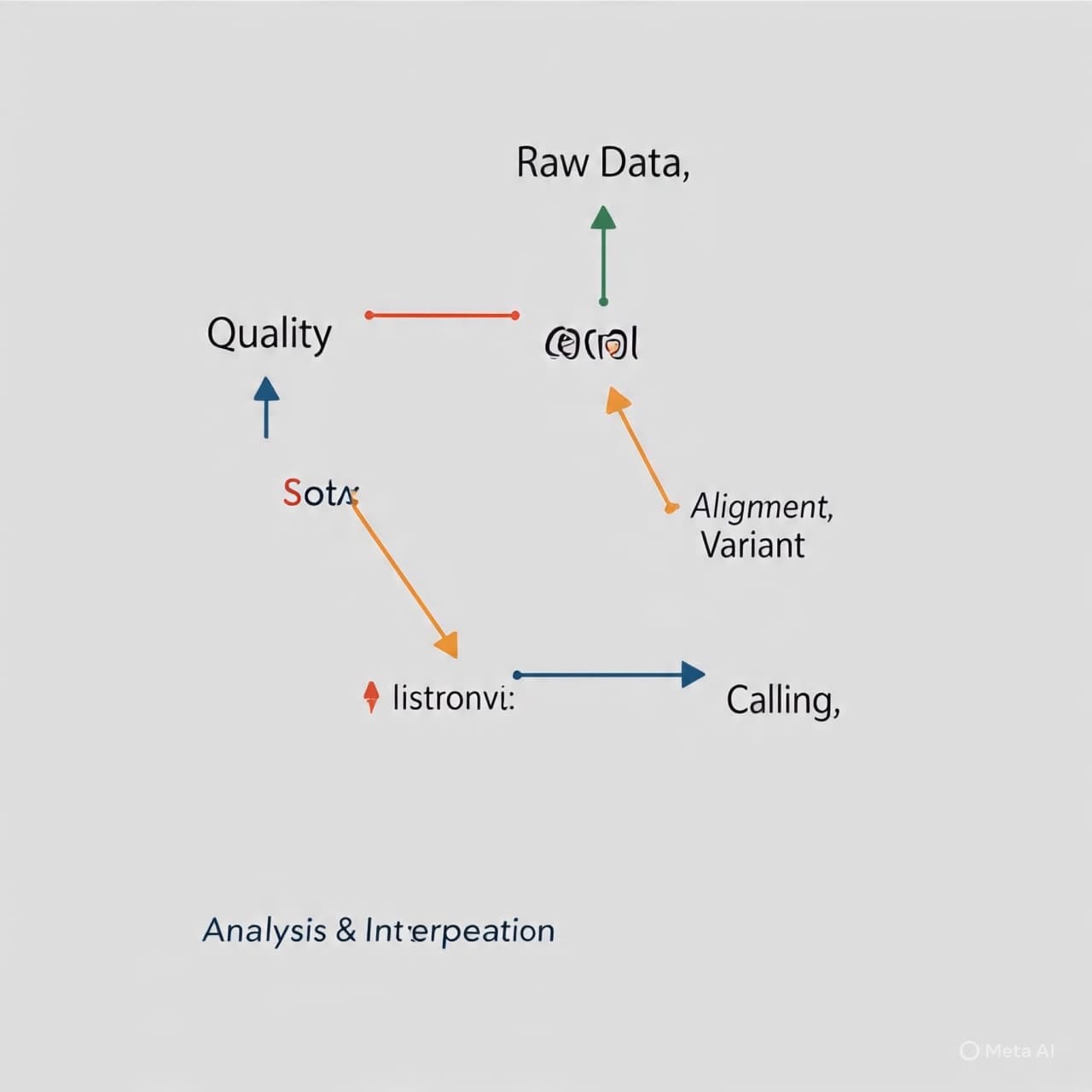

L'introduction d'un pipeline unifié offre une approche différente—celle qui cherche à réduire la variation non pas en limitant l'enquête, mais en établissant un cadre cohérent. En automatisant des étapes clés de l'analyse, de la prétraitement des données à l'alignement et à l'interprétation, le système permet aux chercheurs de naviguer à travers des flux de travail complexes avec une plus grande efficacité et reproductibilité.

Il y a une discipline silencieuse dans une telle standardisation. Elle ne modifie pas le génome lui-même, ni les questions fondamentales posées, mais elle façonne le chemin par lequel les réponses sont atteintes. Ce faisant, elle aide à garantir que les résultats peuvent être comparés à travers les études, à travers les laboratoires, et à travers le temps, formant un corps de connaissances plus cohérent.

Les implications vont au-delà de l'efficacité. Dans des domaines tels que la génomique clinique, où les résultats de séquençage peuvent informer des décisions médicales, la cohérence devient plus qu'une préférence technique—elle devient une partie de la fiabilité. Un pipeline standardisé peut soutenir une interprétation plus claire, réduisant l'incertitude introduite par des différences méthodologiques.

En même temps, le système reflète un mouvement plus large au sein de la science vers l'intégration. À mesure que les ensembles de données croissent en échelle et en complexité, les outils utilisés pour les interpréter doivent évoluer, non seulement en capacité mais en coordination. L'automatisation, dans ce contexte, concerne moins le remplacement de l'insight humain que le soutien à celui-ci—permettant aux chercheurs de se concentrer sur les questions plutôt que sur les processus.

Le flux de données génomiques, autrefois fragmenté et variable, commence à prendre une forme plus continue. Chaque séquence, traitée à travers un cadre partagé, contribue à une structure plus large de compréhension. C'est un alignement graduel, où la complexité n'est pas réduite, mais rendue navigable.

Metapipeline-DNA a été développé pour automatiser et standardiser l'analyse du séquençage génomique, visant à améliorer la reproductibilité et l'efficacité dans les applications de recherche et cliniques. Le système intègre plusieurs étapes analytiques dans un flux de travail unifié, soutenant un traitement cohérent des données génomiques.

Avertissement sur les images AI

Les images sont générées par IA et destinées uniquement à des fins d'illustration conceptuelle.

Vérification des sources

Nature Biotechnology Genome Biology ScienceDaily Phys.org MIT Technology Review