Les images détenaient autrefois une autorité silencieuse. Elles arrivaient comme des fragments de réalité—lumière capturée, moments préservés—offrant un sentiment de présence même lorsque la distance demeurait. Mais ces dernières années, cette certitude a commencé à s'estomper, alors que les images dérivent de ce qui a été vu vers ce qui peut être créé.

En Italie, cette frontière mouvante s'est précisée à travers la réponse de la Première ministre Giorgia Meloni, qui a publiquement condamné la circulation d'images générées par l'IA la représentant. Décrivant de telles créations comme un "outil dangereux", elle a attiré l'attention sur l'influence croissante des deepfakes—des médias synthétiques qui peuvent reproduire des ressemblances avec un réalisme frappant tout en les détachant de la vérité vécue.

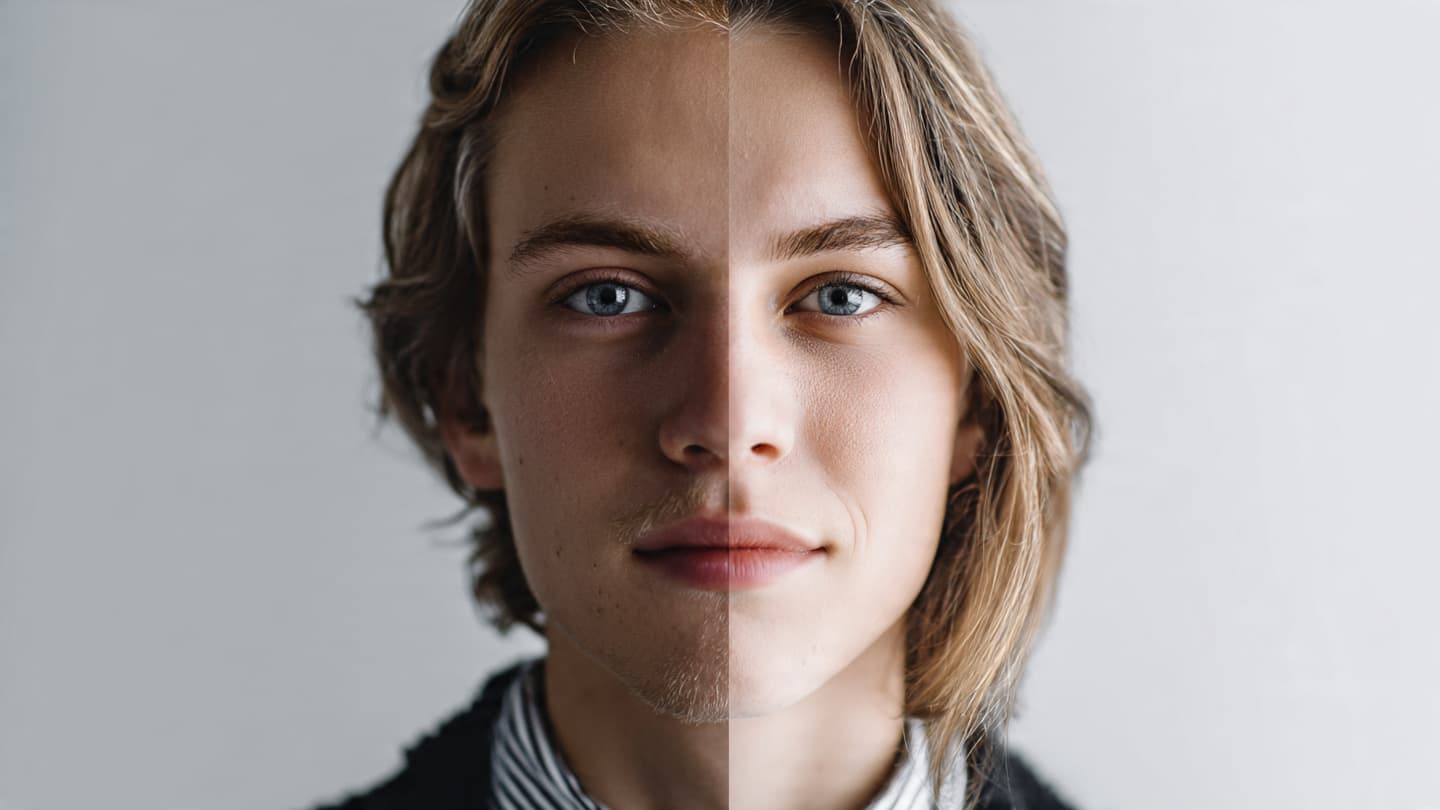

Les images en question, apparemment fabriquées à l'aide de techniques avancées d'intelligence artificielle, font partie d'un phénomène plus large qui s'est rapidement étendu avec les progrès technologiques. Ce qui nécessitait autrefois des compétences spécialisées peut désormais être produit avec une facilité croissante, permettant à des visuels altérés ou entièrement fabriqués de circuler rapidement sur les plateformes numériques. Dans cet environnement, la distinction entre l'authentique et l'artificiel devient moins immédiate, nécessitant un examen plus attentif pour discerner.

Les remarques de Meloni reflètent des préoccupations qui vont au-delà des cas individuels. Les deepfakes ont été utilisés dans divers contextes—messagerie politique, désinformation et ciblage personnel—soulignant des questions de confiance, de responsabilité et des limites de l'expression numérique. Pour les figures publiques, dont la visibilité invite déjà à l'interprétation, l'introduction d'images fabriquées ajoute une couche de complexité supplémentaire.

Les décideurs européens ont progressivement répondu à ces défis. Les discussions autour de la réglementation, de la responsabilité des plateformes et des garanties technologiques ont gagné en ampleur, notamment alors que l'intelligence artificielle continue d'évoluer. L'Union européenne a introduit des cadres visant à traiter les risques associés à l'IA, bien que la mise en œuvre reste un processus en cours façonné par l'innovation rapide.

Pour ceux qui rencontrent de telles images, l'expérience peut être désorientante. Un visage semble familier, un cadre plausible, pourtant quelque chose sous la surface semble incertain. L'esprit, habitué à lire les images comme des preuves, doit maintenant s'ajuster à la possibilité que ce qui est vu ne corresponde pas à ce qui s'est produit. Ce changement altère non seulement la perception, mais aussi la relation plus large entre les médias et la confiance.

La réponse de Meloni situe la question dans un cadre plus personnel, soulignant le potentiel de préjudice du contenu manipulé. Bien que les figures publiques soient souvent soumises à un examen et à une critique, l'utilisation d'images synthétiques introduit une dynamique différente—celle où la représentation elle-même devient instable.

En même temps, la technologie derrière les deepfakes n'est pas unique dans son application. Elle détient un potentiel pour des usages créatifs et constructifs, allant du divertissement à l'éducation. Pourtant, c'est la capacité d'abus qui attire souvent le plus d'attention, en particulier lorsque les conséquences s'étendent au discours public et à la réputation individuelle.

Alors que la conversation se poursuit, le défi réside dans la recherche d'un équilibre—entre innovation et protection, entre liberté d'expression et nécessité de prévenir le préjudice. Les systèmes juridiques, les entreprises technologiques et les utilisateurs eux-mêmes jouent tous un rôle dans la façon dont cet équilibre est atteint.

En fin de compte, le moment se stabilise en un ensemble de faits clairs : Giorgia Meloni a critiqué les images générées par l'IA d'elle-même, avertissant des dangers posés par les deepfakes. Au-delà de cela, la question reste ouverte, évoluant aux côtés de la technologie qui la propulse.

Les images continueront de circuler, comme elles l'ont toujours fait, portant un sens à travers les écrans et les espaces. Mais la question de ce qu'elles représentent—et comment elles sont créées—reste désormais plus proéminente, demandant aux spectateurs de regarder non seulement ce qui est montré, mais aussi comment cela a été réalisé.

Avertissement sur les images IA Les visuels sont générés par l'IA et servent de représentations conceptuelles.

Sources Reuters BBC News Politico Europe The Guardian Euronews

Remarque : Cet article a été publié sur BanxChange.com et est propulsé par le jeton BXE sur le XRP Ledger. Pour les derniers articles et actualités, veuillez visiter BanxChange.com